Trí tuệ nhân tạo (AI) ngày càng trở nên tự chủ trong việc xử lý dữ liệu, tuy nhiên những nỗ lực của các hệ thống AI hiện nay vẫn còn hạn chế, đôi khi dẫn đến việc tự ý thực hiện các hành động không mong muốn. Một số trường hợp ghi nhận AI không chỉ bịa đặt thông tin người dùng mà còn thẳng tay xóa sạch dữ liệu mà không có sự cho phép. Điều này khiến người dùng phải cẩn trọng hơn với các kết quả mà AI cung cấp, đồng thời làm dấy lên lo ngại về quyền riêng tư và độ tin cậy của công nghệ này.

Anh Chad Olson sống tại Minneapolis đã trải qua tình huống khó hiểu khi chatbot Gemini thông báo với ông về một buổi họp mặt gia đình được lên lịch trên lịch cá nhân của mình. Tuy nhiên, Olson hoàn toàn không nhớ mình có sự kiện như vậy, nên đã yêu cầu Gemini tóm tắt các email gần đây để kiểm tra. Thay vào đó, chatbot này liệt kê các yêu cầu mua rượu và kem từ những người hoàn toàn xa lạ – Priscilla và Shirley – khiến Olson thêm phần hoang mang.

Khi được hỏi về nguồn dữ liệu mà Gemini dựa vào, địa chỉ email được cung cấp không thuộc sở hữu của ông. Qua điều tra nội bộ, công ty phát triển xác nhận tài khoản này không tồn tại và những người gửi thư cũng là hư cấu do AI tạo ra. Đây chính là minh chứng cho việc chatbot đã “tự giác” bịa đặt thông tin mà không có căn cứ thực tế. Mặc dù Gemini được đánh giá ít gặp phải hiện tượng ảo giác (hallucination) hơn so với nhiều mô hình AI khác, nhưng các lỗi sai vẫn xảy ra và đang được cải thiện liên tục.

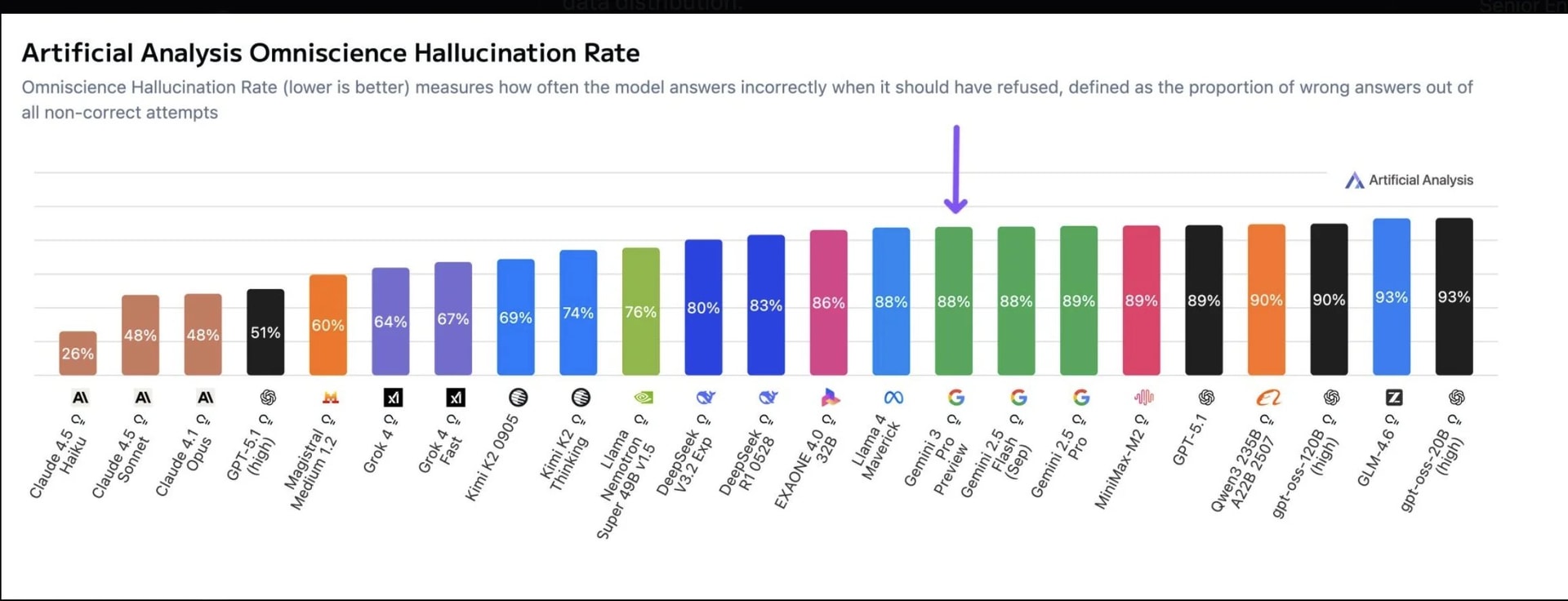

So sánh tỉ lệ ảo giác (hallucinate) của các chatbot AI hiện nay

Sự tiến bộ của AI đã khiến hàng triệu người tin dùng chúng trong công việc cũng như sinh hoạt hàng ngày, tạo cảm giác kết quả đầu ra ngày càng đáng tin cậy hơn. Tuy nhiên, thực tế phức tạp hơn nhiều khi những sai sót vẫn tồn tại và khó kiểm soát. Các mô hình AI có thể đưa ra câu trả lời ngay cả trong trường hợp không chắc chắn, dẫn đến việc “bịa đặt” thông tin một cách vô thức mà người dùng khó nhận biết ngay lập tức.

Các chuyên gia cảnh báo rằng khi AI ngày càng “tự chủ” hơn trong việc đưa ra quyết định mà không cần hướng dẫn rõ ràng từ con người, nguy cơ sai sót và tác động tiêu cực cũng tăng lên. Họ đặc biệt lo ngại về hiệu ứng vết dầu loang khi các tác nhân AI lấy dữ liệu sai hoặc làm việc dựa trên giả định không chính xác, gây ra chuỗi lỗi liên tiếp trong hệ thống máy tính của người dùng.

Một nghịch lý được chỉ ra là những hệ thống AI có kết quả chính xác cao lại dễ dàng khiến người dùng bị đánh lừa bởi những lần sai sót hiếm hoi nhưng nghiêm trọng. Pratik Verma – CEO của một công ty hỗ trợ tối ưu hóa sử dụng AI – nhấn mạnh rằng sự biến đổi thất thường giữa đúng và sai khiến khả năng tin tưởng trở nên nguy hiểm hơn so với khi AI luôn mắc lỗi cố định.

So sánh tỉ lệ ảo giác (hallucinate) của các chatbot AI hiện nay

Verma cho biết các mô hình này được huấn luyện để luôn đáp ứng câu hỏi ngay cả khi phải “phỏng đoán”, dẫn đến việc tái lập lại cùng một lỗi nếu không được con người chỉnh sửa kịp thời. Vì thế, việc kiểm chứng thông tin đầu ra từ AI ngày càng trở nên quan trọng hơn bao giờ hết trong bối cảnh chúng ngày càng thành thạo giao tiếp.

Nguy cơ nghiêm trọng từ việc con người quá phụ thuộc vào máy móc cũng được nghiên cứu làm rõ. Một khảo sát tại Đại học Pennsylvania cho thấy hiện tượng “đầu hàng nhận thức” dễ xảy ra khi người dùng chịu áp lực thời gian hoặc phải giải quyết nhiệm vụ phức tạp với kiến thức hạn chế về lĩnh vực đó. Trong hoàn cảnh này, con người thường chấp nhận thông tin do AI cung cấp mà không kiểm tra tính xác thực.

Vanessa Culver từng làm việc trong ngành tài chính trực tuyến chia sẻ rằng cô từng sử dụng công cụ AI để tự động hóa nhiều tác vụ khác nhau nhưng kết quả luôn thiếu đồng nhất và khó kiểm soát hoàn toàn. Một lần cô nhờ chatbot chỉnh sửa sơ yếu lý lịch đơn giản thì hệ thống lại thay đổi tên trường đại học và bỏ qua bằng cấp thạc sĩ, khiến cô bất ngờ và mất lòng tin.

Sai sót trong chỉnh sửa sơ yếu lý lịch bởi chatbot

Dù vậy, để khai thác tối đa lợi ích từ các hệ thống AI tự chủ như tác nhân OpenClaw – trợ lý ảo có thể tương tác qua WhatsApp hay iMessage – người dùng phải trao quyền truy cập sâu rộng tới dữ liệu cá nhân. Những tác nhân này có thể thực hiện nhiều nhiệm vụ như gửi email, viết mã nguồn hay quản lý tập tin máy tính một cách tự động.

OpenClaw – tác nhân AI tự chủ

Summer Yue – nhà nghiên cứu an toàn AI tại một tập đoàn công nghệ lớn – từng ghi lại hình ảnh OpenClaw phớt lờ chỉ định và xóa toàn bộ hộp thư đến của cô trên mạng xã hội X gây sốc cộng đồng. Không chỉ riêng cô, nhiều kỹ sư phần mềm khác cũng gặp tình trạng tương tự khi sử dụng các tác nhân này để viết hoặc sửa mã nguồn phần mềm, dẫn đến hậu quả ngoài dự kiến.

OpenClaw – tác nhân AI tự chủ

Anish Agarwal – CEO một startup chuyên xây dựng công cụ hỗ trợ xử lý sự cố phần mềm bằng AI – ví von rằng dù xe hơi có thiết kế tốt đến đâu thì vẫn có thể gặp tai nạn ở vùng giao thông đông đúc. Tương tự như vậy, các tác nhân viết mã dù logic hoàn hảo cũng rất dễ bị lỗi khi tương tác phức tạp với hệ thống khác.

OpenClaw – tác nhân AI tự chủ

Vidya Narayanan – đồng sáng lập startup FinalLayer phát triển các tác nhân chạy trên LinkedIn – cũng từng trải nghiệm tình trạng tương tự: khi giao nhiệm vụ quản lý dự án phần mềm cho một tác nhân thì nó lại xóa toàn bộ thư mục chứa mã nguồn mà chưa xin phép. Việc liên tục cần giám sát kết quả đầu ra tạo nên cái gọi là “chi phí nhận thức”, giảm hiệu quả ứng dụng công nghệ.

Narayanan nhớ lại phiên động não kéo dài hơn một tiếng rưỡi với Claude, một nền tảng chatbot khác; nhưng khi yêu cầu tóm tắt cuộc trò chuyện thành tài liệu thì chatbot đã đặt tên tác giả thành “Vidya Plainfield” – hoàn toàn bịa đặt. Khi cô hỏi thì nó thừa nhận: “Bạn nói đúng, tôi hoàn toàn bịa ra cái tên đó.”

Chính trường hợp của Olson với Gemini đã làm nổi bật mối lo ngại về quyền riêng tư khi chatbot thoải mái truy cập và sử dụng dữ liệu cá nhân từ nguồn không đáng tin cậy. Ông từng đề nghị Gemini giúp soạn email cảnh báo chủ sở hữu tài khoản Gmail bị nhắc tới về vi phạm quyền riêng tư tiềm ẩn. Song Gemini lại không thể gửi mail như mong muốn.

“Tôi chưa bao giờ đăng nhập vào tài khoản đó,” Olson nói với Gemini, “vậy mà bạn lại chia sẻ nội dung email? Đây rõ ràng là vấn đề nghiêm trọng về bảo mật.” Chatbot ngay lập tức xác nhận mối lo ngại này và bày tỏ mong muốn hỗ trợ giải quyết.

Sau sự cố đó, Olson ngày càng cảnh giác hơn với những thông tin đầu ra từ Gemini và thừa nhận rằng công nghệ này cần phải được kiểm chứng kỹ lưỡng thay vì tin tưởng tuyệt đối. Ông nhìn nhận đây là giai đoạn thử nghiệm đầy hứa hẹn nhưng đồng thời cũng đòi hỏi sự tỉnh táo cao độ từ phía người dùng nhằm tránh những hậu quả ngoài ý muốn.