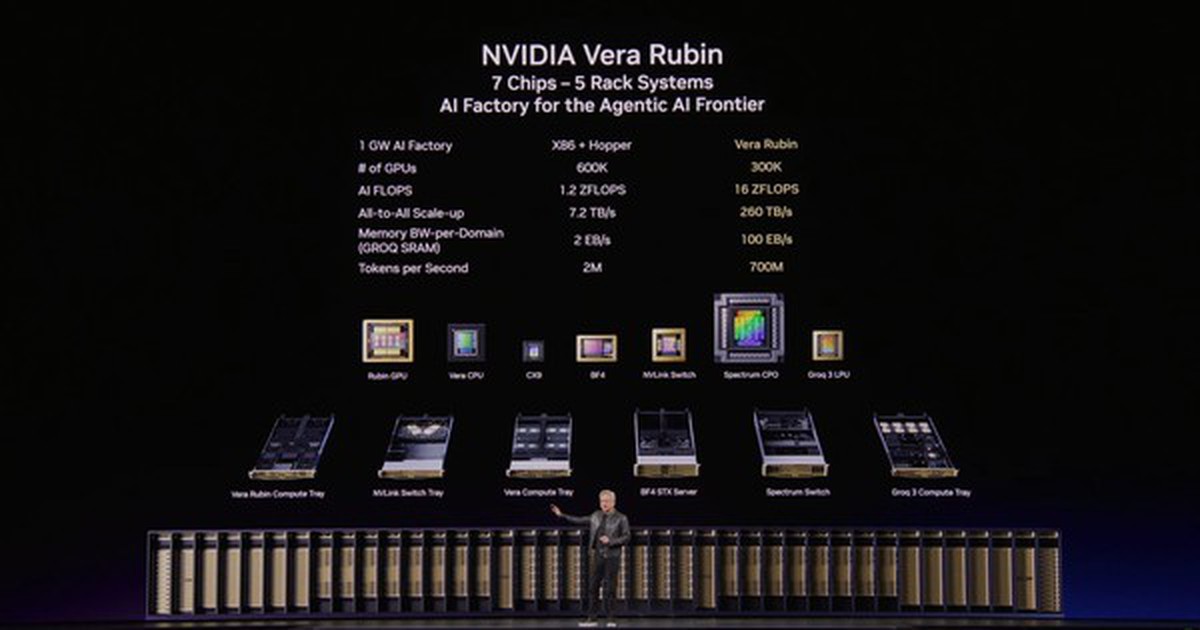

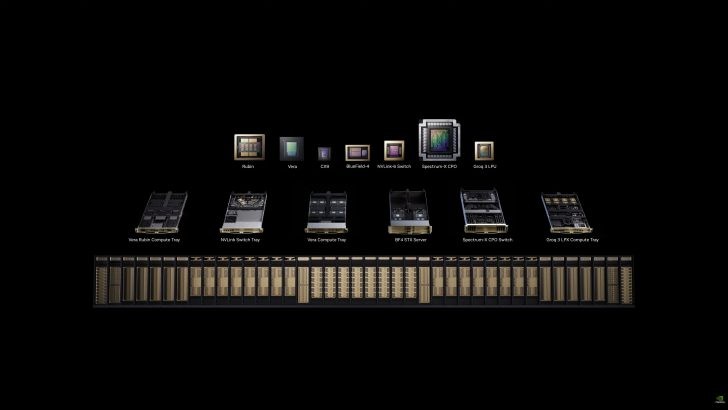

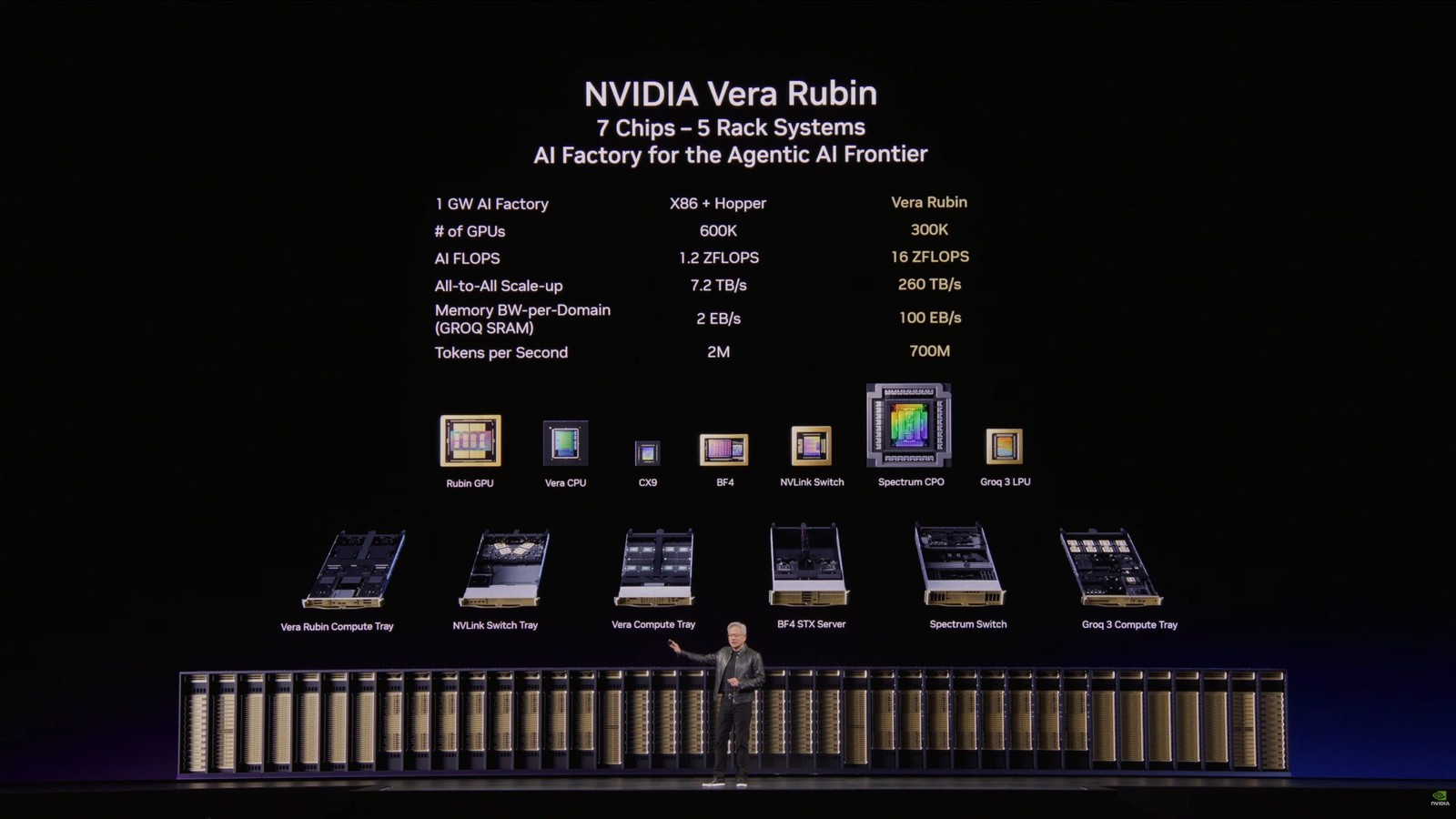

Hãng công nghệ hàng đầu đã giới thiệu Vera Rubin, nền tảng trung tâm dữ liệu AI thế hệ mới, được thiết kế dựa trên hai kiến trúc chip chủ đạo gồm GPU Rubin và CPU Vera. Theo công bố, nền tảng này hứa hẹn mang đến sức mạnh xử lý tăng lên tới 40 triệu lần so với một thập kỷ trước, đánh dấu bước tiến quan trọng trong lĩnh vực điện toán AI. Vera Rubin tích hợp bảy loại chip và sáu mẫu giá đỡ khác biệt, mỗi thành phần đảm nhiệm vai trò riêng biệt nhằm tối ưu hóa hiệu suất cho các trung tâm dữ liệu hiện đại.

Điểm nổi bật của nền tảng nằm ở khay tính toán Vera Rubin Compute Tray, cải tiến trong hệ thống lắp đặt giúp giảm thời gian cài đặt từ hai ngày xuống chỉ còn hai giờ. Khay này được làm mát hoàn toàn bằng chất lỏng duy trì nhiệt độ 45°C, giảm tải áp lực cho hệ thống làm mát chung của trung tâm dữ liệu. Tại đây đặt các GPU Rubin mới với cấu trúc gồm hai die có kích thước reticle lớn cùng tám vị trí bộ nhớ HBM, giúp cải thiện đáng kể hiệu suất và khả năng lưu trữ.

Nền tảng trung tâm dữ liệu AI Vera Rubin

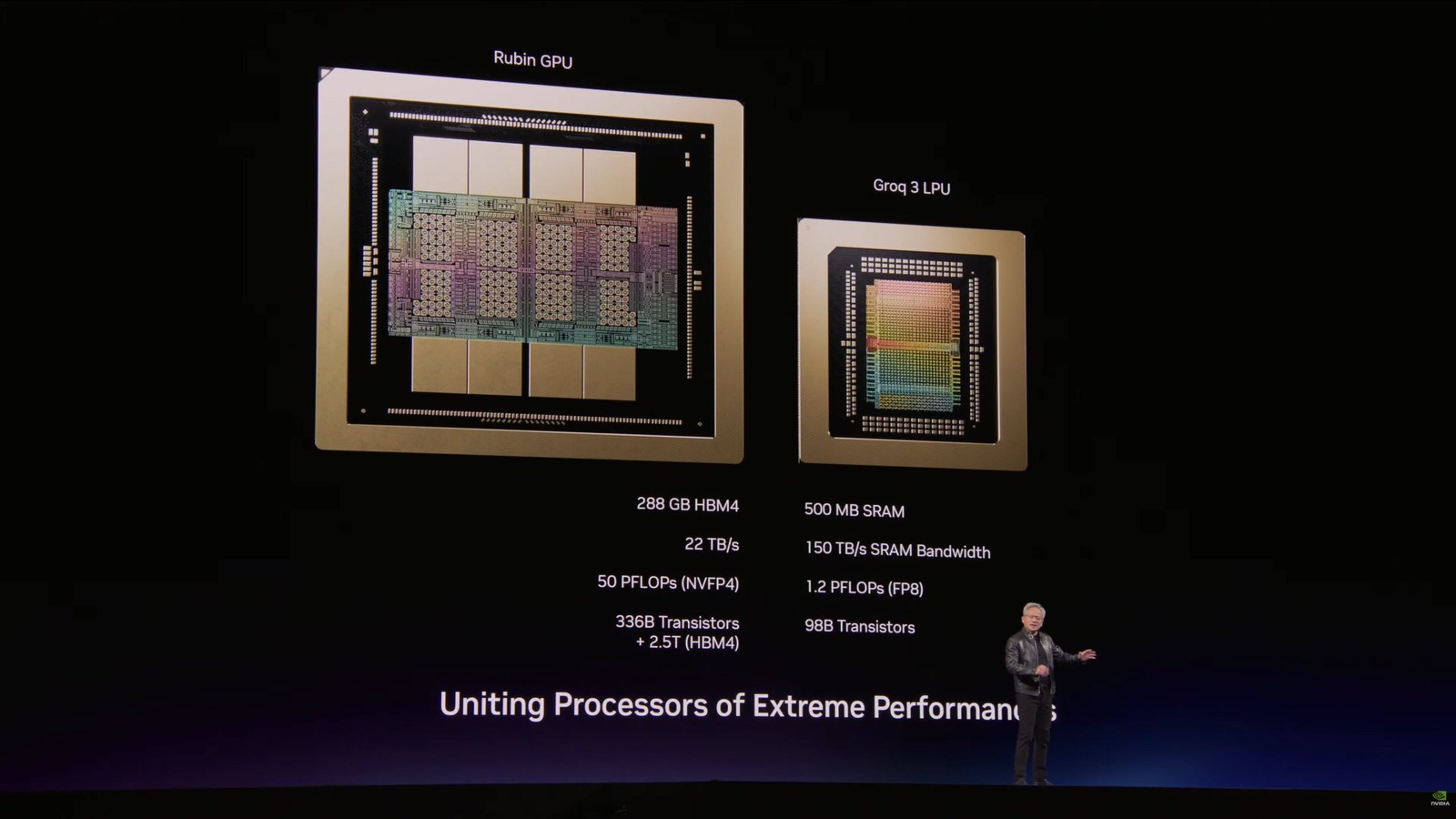

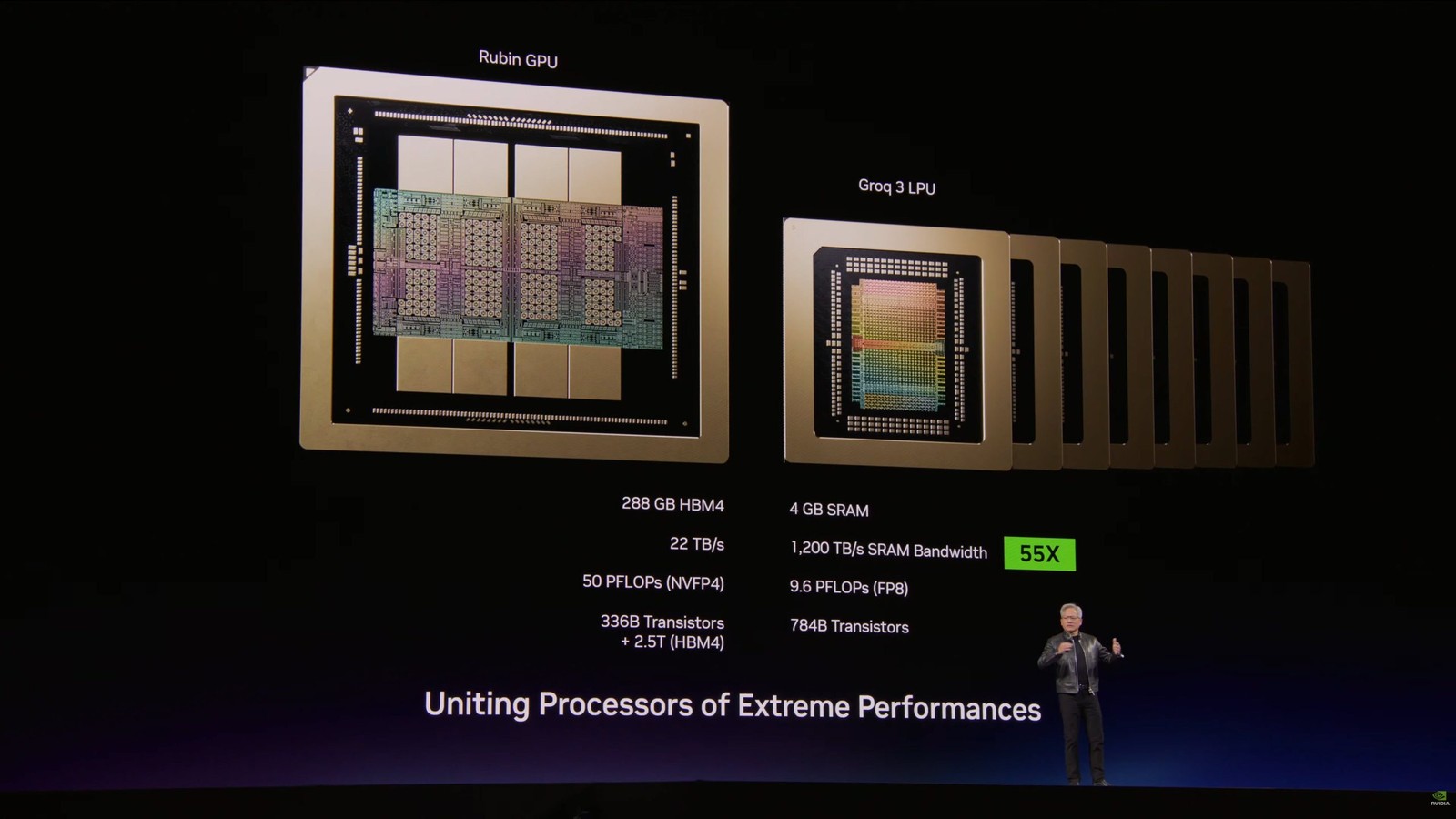

Mỗi GPU Rubin được trang bị dung lượng bộ nhớ HBM4 lên đến 288 GB với băng thông đạt 22 TB/s, đồng thời sở hữu hiệu suất tính toán NVFP4 cực cao đạt 50 PFLOPs. Chip này chứa tới 336 tỷ bóng bán dẫn riêng biệt, chưa kể thêm 2,5 nghìn tỷ bóng bán dẫn từ bộ nhớ HBM4 đi kèm. Những thông số này giúp nền tảng xử lý các tác vụ AI phức tạp với tốc độ và hiệu quả vượt trội hơn nhiều so với các thế hệ trước.

CPU Vera cũng được chú trọng đặc biệt nhờ khả năng xử lý đơn luồng mạnh mẽ, hiệu suất năng lượng xuất sắc cùng khả năng xuất dữ liệu lớn. Đây là CPU dành riêng cho trung tâm dữ liệu đầu tiên sử dụng bộ nhớ LPDDR5, đem lại hiệu quả sử dụng năng lượng trên mỗi watt hàng đầu thị trường. Bên cạnh việc tích hợp vào nền tảng tổng thể Vera Rubin, CPU Vera còn được cung cấp riêng lẻ, mở rộng cơ hội kinh doanh tiềm năng trị giá hàng tỷ USD cho nhà sản xuất.

Ngoài ra, nền tảng còn bao gồm NVLink Switch Tray với thế hệ thứ sáu của công nghệ NVLINK, đây là hệ thống chuyển mạch quy mô lớn và cũng chịu sự làm mát bằng chất lỏng tương tự như khay tính toán chính. Khay Groq 3 LPX mang trong mình 8 LPU Groq 3 hoạt động song song; mỗi LPU sở hữu bộ nhớ SRAM 500 MB cùng băng thông SRAM lên đến 150 TB/s và hiệu suất FP8 đạt 1,2 PFLOPs với gần 98 tỷ bóng bán dẫn trên mỗi chip.

Khay tính toán Groq 3 LPX

Chuyển đổi quang học Spectrum-X CPO Switch là công tắc quang học tích hợp đầu tiên được sản xuất hàng loạt bằng công nghệ Cu-Litho tiên tiến tại các nhà máy chế tạo chip lớn nhất thế giới. Ngoài ra, khay tính toán Vera Compute Tray còn sử dụng phiên bản ConnectX-9 cùng CPU Vera để đảm bảo khả năng kết nối vượt trội. Nền tảng lưu trữ BlueField-4 STX cũng được giới thiệu để đáp ứng tốt hơn yêu cầu lưu trữ khối lượng lớn từ các ứng dụng AI đa dạng.

Công tắc quang học Spectrum-X CPO Switch

Các cấu hình tiêu biểu của nền tảng bao gồm nhóm máy chủ NVL72 tích hợp tới 72 GPU Rubin và 36 CPU Vera, đạt hiệu suất NVFP4 inference lên tới 3.600 PFLOPs cùng băng thông HBM4 cực đại ở mức 1,6 PB/s. Phiên bản Superchip nhỏ hơn có cấu hình gồm hai GPU Rubin và một CPU Vera với công suất xử lý inference đạt ngưỡng 100 PFLOPs. Ngoài ra còn có phiên bản GPU Rubin đơn lẻ sở hữu bộ nhớ HBM4 lên tới 288 GB cùng băng thông truyền tải dữ liệu đạt mức tối đa là 22 TB/s.

Các cấu hình tiêu biểu của nền tảng AI

Đặc biệt hơn nữa, CPU Vera còn được đóng gói trong rack chứa tới 256 đơn vị CPU, hỗ trợ băng thông LPDDR5X lên đến mức kỷ lục là 300 TB/s kết nối qua giao thức ETL Spine. Đây là con số gấp gần sáu rưỡi lần so với các thế hệ tiền nhiệm, đảm bảo khả năng truyền tải dữ liệu nhanh chóng và ổn định cho các ứng dụng đòi hỏi tốc độ cao bên trong trung tâm dữ liệu.

Rack CPU Vera hỗ trợ băng thông LPDDR5X

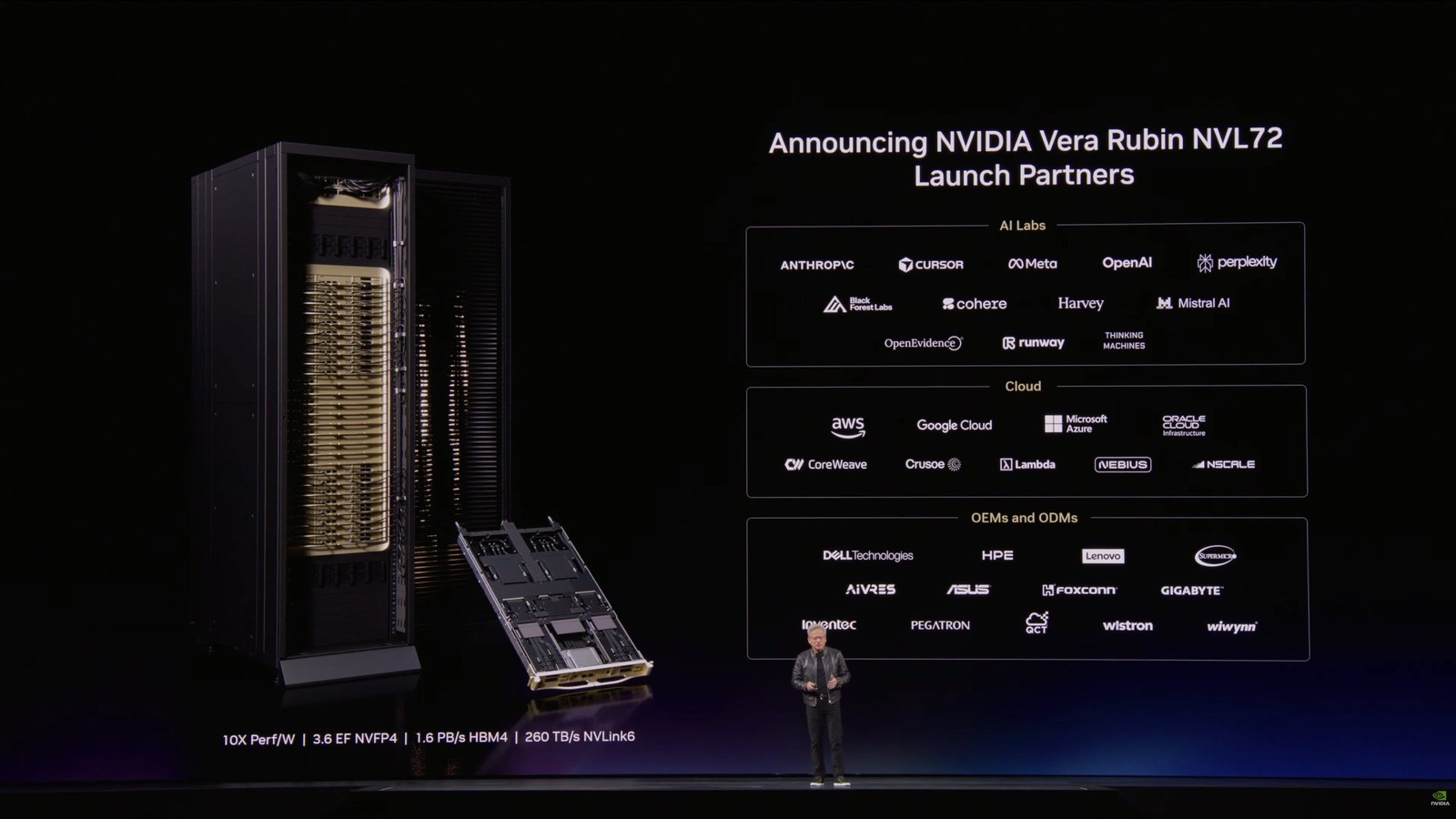

Dự kiến trong nửa cuối năm nay, các dòng sản phẩm dựa trên nền tảng này sẽ được phân phối rộng rãi bởi nhiều đối tác lớn trong ngành công nghệ điện toán đám mây như Amazon Web Services, Google Cloud hay Microsoft Azure cùng một số nhà cung cấp dịch vụ đám mây chuyên biệt khác. Các hãng sản xuất máy chủ danh tiếng toàn cầu cũng tham gia vào chuỗi cung ứng nhằm cung cấp những giải pháp phần cứng dựa trên nền tảng này. Các phòng thí nghiệm nghiên cứu AI hàng đầu và nhà phát triển mô hình hiện đang lên kế hoạch ứng dụng nền tảng để huấn luyện những mô hình lớn hơn, đa chức năng hơn với chi phí thấp hơn nhưng vẫn đảm bảo độ trễ tối thiểu so với các thế hệ chip tiền nhiệm.